« Comme dans beaucoup d’entreprises on sait que l’intelligence artificielle générative (IA) est présente dans le quotidien de nos salariés, il était donc urgent d’encadrer son usage », affirme Jean-Noël Olivier. Selon le directeur général du numérique et des systèmes d’information de Bordeaux Métropole, une grande partie des effectifs utilisent l’IA régulièrement, « sans que l’on sache pour quoi ni pour quel besoin ».

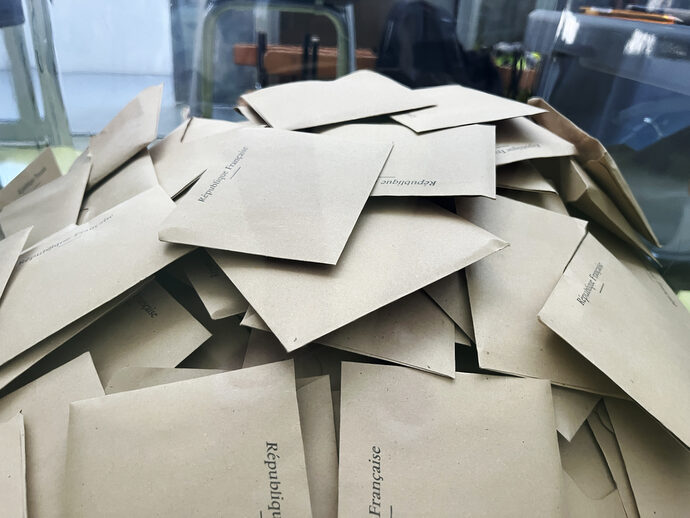

« 30% de nos agents utilisent ChatGPT alors qu’on leur a demandé de ne pas le faire, car ils y intègrent des documents administratifs pas forcément validés pour les résumer, les amender, les améliorer », indique Delphine Jamet, conseillère métropolitaine déléguée au numérique :

« Quand on met ces données, qui sont des archives publiques, dans ChatGPT ou autre logiciel des Gafam, on leur donne toute notre connaissance et nos biens communs, dont ils se servent pour rendre leurs algorithmes encore plus performants. Donc aujourd’hui nous avions besoin de ce cadre éthique. »

Cet article fait partie de l’édition abonnés. Pour lire la suite, profitez d’une offre découverte à 1€.

Contribuez à consolider un média indépendant à Bordeaux, en capacité d’enquêter sur les enjeux locaux.

- Paiement sécurisé

- Sans engagement

Déjà abonné⋅e ?

Connectez-vous

Chargement des commentaires…